qianchengV2EX member #127171, joined on 2015-07-14 19:02:25 +08:00 |

| Per qiancheng's settings, the topics list is hidden |

Deals info, including closed deals, is not hidden

qiancheng's recent replies

Feb 11 Replied to a topic by xiaoxiaodong 生活 购买摄像头咨询 |

TPLINK 的 IPC48DW

Feb 10 Replied to a topic by qiancheng Cursor 如何让 cursor ide 改代码的时候不要瞎几把改 |

@tomatocici2333 这个最佳实践也值得一看,感谢

Jan 26 Replied to a topic by raw0xff 程序员 如果说“语言的边界就是思想的边界”,那么与 AI 对话是否有必要用英文? |

从训练模型的原理上来看 tokenizer 对中文和英文编码的 token id 是不一样的,虽然经过 ROPE 位置编码,中英文混合语料训练过,表面上看回答的头头是道,但是中英文的表现会有较大差异。

1 、大家可能记得 llama3/4 在中文上的表现一塌糊涂,但是在英文上的表现尚可

2 、国内的大模型基座训练会增大中文语料比率,以及增加一下中文互联网常见的语料和书籍,所以大家实际在用大模型比如豆包,千问,deepseek 时候会感觉中文的思考能力和回答的模式接近正常人,这是因为在 post-training 以及 RL 阶段对齐了中国人在日常的常见场景,这也是为什么有的会给你推荐中药和中医的原理,以及算命,阴阳等。

不要忘记大模型发展到如此智能的当下,依然建立在概率论和语料的基础上的。

我赞同 #16 rick13 的观点,如果你能引导 AI 用英语思维,critic thinking 这是最好,但不完全代表你用纯英文问国内的 GPT 就能获得比中文 prompt 得到更好的更高质量的回答,因为国内的 GPT 在英文语料上的训练比率较低,且没有后续多阶段精调。

如果你希望 AI 能更好辅助你,首先你自己要能够 critic thinking ,并验证信息源,尽量不带偏见使用开放式问答,多角度反复尝试多个 GPT 。

1 、大家可能记得 llama3/4 在中文上的表现一塌糊涂,但是在英文上的表现尚可

2 、国内的大模型基座训练会增大中文语料比率,以及增加一下中文互联网常见的语料和书籍,所以大家实际在用大模型比如豆包,千问,deepseek 时候会感觉中文的思考能力和回答的模式接近正常人,这是因为在 post-training 以及 RL 阶段对齐了中国人在日常的常见场景,这也是为什么有的会给你推荐中药和中医的原理,以及算命,阴阳等。

不要忘记大模型发展到如此智能的当下,依然建立在概率论和语料的基础上的。

我赞同 #16 rick13 的观点,如果你能引导 AI 用英语思维,critic thinking 这是最好,但不完全代表你用纯英文问国内的 GPT 就能获得比中文 prompt 得到更好的更高质量的回答,因为国内的 GPT 在英文语料上的训练比率较低,且没有后续多阶段精调。

如果你希望 AI 能更好辅助你,首先你自己要能够 critic thinking ,并验证信息源,尽量不带偏见使用开放式问答,多角度反复尝试多个 GPT 。

Jan 26 Replied to a topic by Chris008 问与答 开始幻想 是否有不需要工作就能免费吃住的地方 |

Zoo

Jan 22 Replied to a topic by silencelixing Mac mini Mac mini 适合跑什么本地模型? |

afmd 可以看看大佬弄的苹果自己的本地模型 API ,速度还不错,对资源占用少

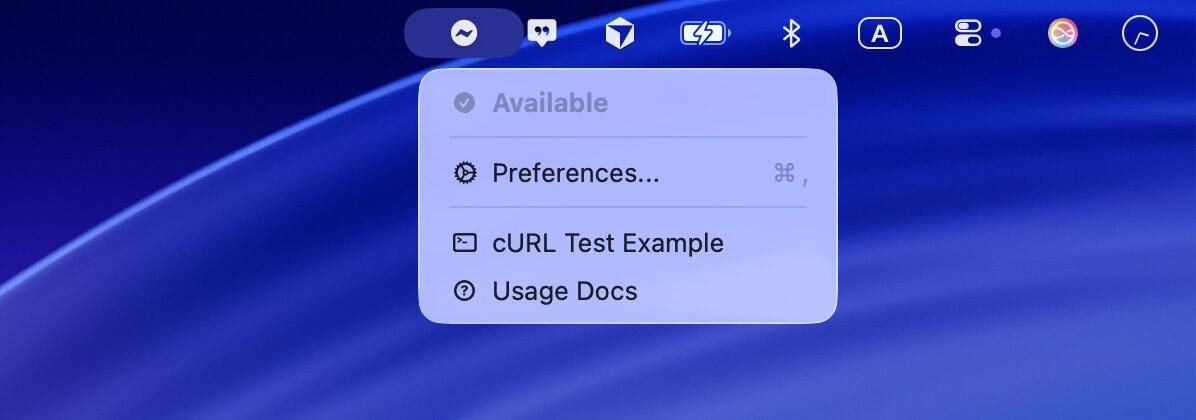

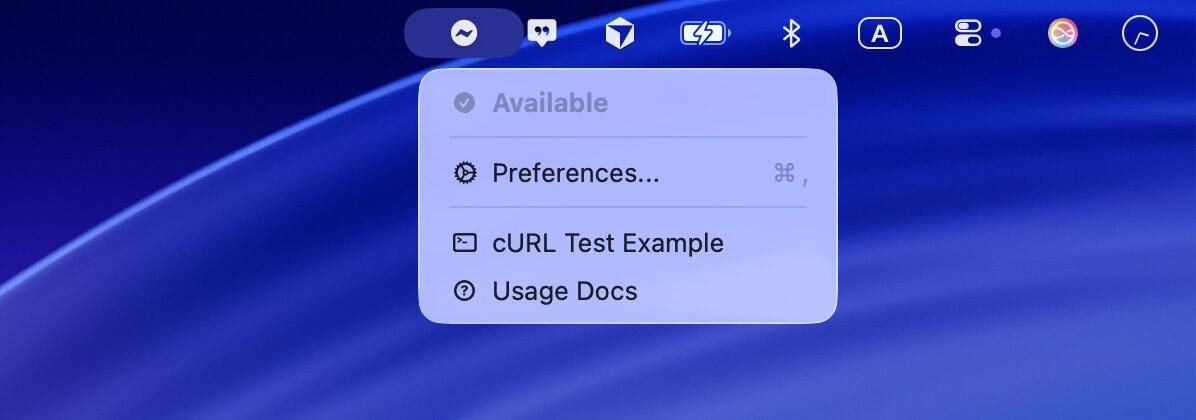

https://github.com/iqiancheng/afmd#readme

https://github.com/iqiancheng/afmd#readme

Jan 22 Replied to a topic by suueyoung macOS 直到现在还不想换 MacOS 的原因, 只剩下 Win+ V & Everything 了 |

Everything -> HoudahSpot

win + V -> Maccy

win + V -> Maccy

Jan 21 Replied to a topic by rolandzhou macOS 发现 macOS 自带的 say 命令的文字转语音效果提升了 |

say good job